Visualización de emociones a través del diseño generativo.

Materia Errante es un experimento enfocado en visualizar las emociones de los usuarios en tiempo real, para poder analizar los cambios basados en temas de conversación predeterminados, estímulos y variables externas, sin tener control sobre el resultado.

Video Pitch

Equipo Ganador del Centro Roberto Garza Sada’s Ticket To Fly “Mejor Proyecto General” 2022

& Premio A! Diseño “I am The Designer” Identidad - Estudiante

“The wanderer will

never truly be lost.”

Ellen LuptonEquipo

María Martínez, Paola Garza, Raúl Amezaga y Jessica Mendirichaga

Año

2022

Materia Viva

Cada quien tiene su propio laberinto,

su propio camino y su propio resultado. Este concepto representa el núcleo de nuestra identidad. En Materia Errante creemos que nuestros usuarios son viajeros que nunca dejan de avanzar. Con errores e imperfecciones, cada quien sigue caminando… como materia errante, que no se queda quieta.

Fases del proyecto

Sub-fases del desarrollo

Percecpción

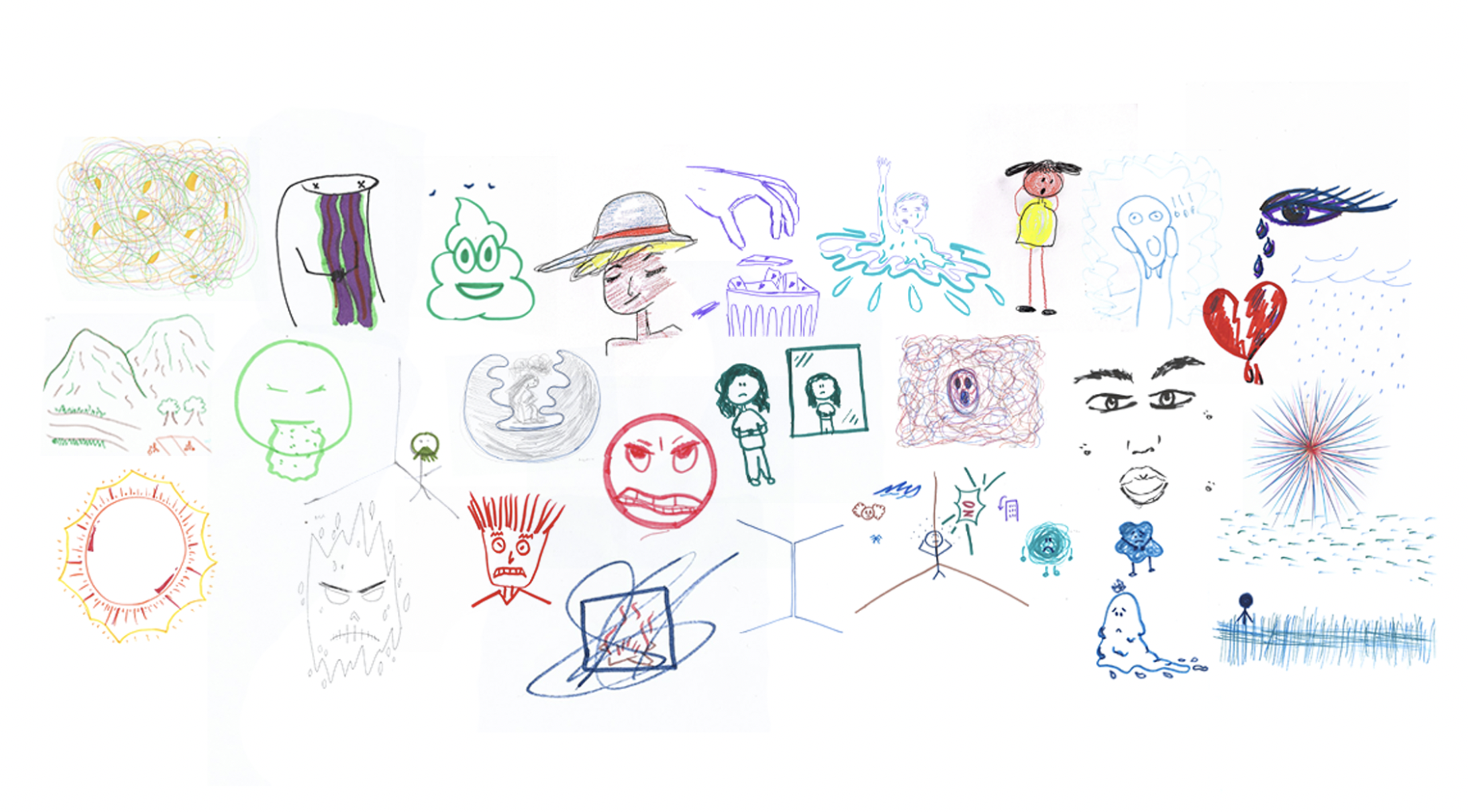

Le preguntamos a 28 jóvenes universitarios que dibujaran lo que para ellos representa cada emoción (alegría, ira. miedo, asco, desprecio, sorpresa, tristeza) para comenzar a rastrear patrones que indicaran características importantes de cada emoción.

Stable Diffusion

A partir de la percepción de los usuarios en el focus group, se desarrollaron alrededor de 300 imágenes representativas de las emociones desde cero, utilizando un modelo de Inteligencia Artificial conocido como Stable Diffusion.

Prueba piloto

Con las imágenes desarrolladas, se hicieron 16 experimentos con 32 jóvenes universitarios. En estos experimentos había dos personas que acomodan las imágenes en la emoción donde pensaban que pertenecía.

Análisis de resultados

En base a la prueba piloto se hizo un análisis para encontrar los colores más repetidos y las palabras clave de cada emoción.

Asimismo, se analizó el nivel de abstracción en las imágenes utilizadas en cada emoción en la prueba piloto. Se encontró que en todas las emociones dominaban las imágenes figurativas; la única excepción fue sorpresa, en la que había mayoría de abstractas.

Después, se desarrolló desde cero un nuevo data set de alrededor de 5,000 imágenes con Google Collaboratory, usando el modelo de Clip Guided Diffusion.

Entrenamiento del modelo

Se entrenó el modelo con Pix2Pix a través de Redes Generativas Antagónicas (GAN), el cual consiste en una red generativa y otra discriminadora. La red generativa desarrolla imágenes irreales desde cero, y después esas imágenes pasan el filtro del discriminador.

Conforme se va entrenando el modelo y más imágenes son generadas, el discriminador es engañado por el generador, logrando hacer cada vez archivos más parecidos a la realidad.

Experimento

Poner a prueba el modelo desarrollado y descubrir si nuestra pregunta de investigación era correcta:

¿Podemos intervenir la percepción de las emociones de los usuarios a través de diseño generativo?

-

Reunimos a usuarios en parejas para llevar a cabo conversaciones en las que se puedan apreciar las siete emociones universales analizadas en este proyecto: alegría, tristeza, ira, asco, sorpresa, desprecio y miedo. Se hicieron tarjetas con temas o preguntas que pudieran despertar estas emociones en los usuarios.

-

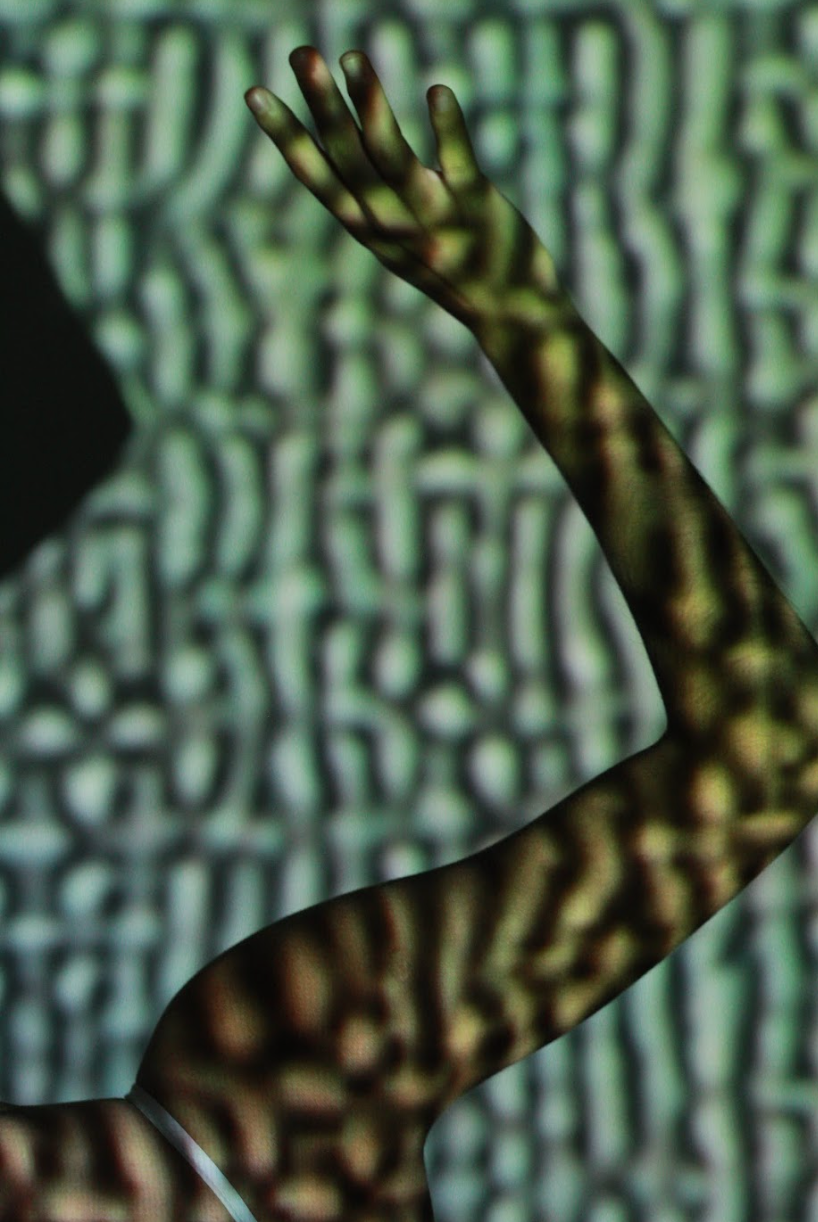

Es capaz de reconocer las emociones del usuario en tiempo real a través de sus expresiones faciales.

Al reconocer una emoción, el modelo proyecta gráficos únicos y con paleta de color atribuyente a cada emoción.

Para el entrenamiento se utilizó: Stable Diffusion, Clip Guided Diffusion, Pix2Pix con GAN (Generative Adversarial Network), Color Transfer2 con Open CV, Modelo de Reconocimiento de Emociones con p5.js, entre otros.

-

Dos computadoras estuvieron conectadas a una sesión de Zoom mientras que una proyectaba la generación de las imágenes, y la otra estaba conectada a la webcam para el reconocimiento de emociones, transmitiendo todo en tiempo real.